Meta vient de lancer Llama 4, sa nouvelle gamme de modèles d’intelligence artificielle. Celle-ci serait alors pensée pour repousser les limites de l’open source tout en s’alignant sur les meilleurs standards du marché. Son arrivée s’inscrit dans un contexte de forte pression concurrentielle. Le lancement de DeepSeek R1 début 2025 a surpris l’industrie par son efficacité et ses coûts réduits. Ce modèle open source a conduit Meta à accélérer le développement de sa nouvelle série.

Sommaire :

Llama 4 : des modèles ouverts et performants

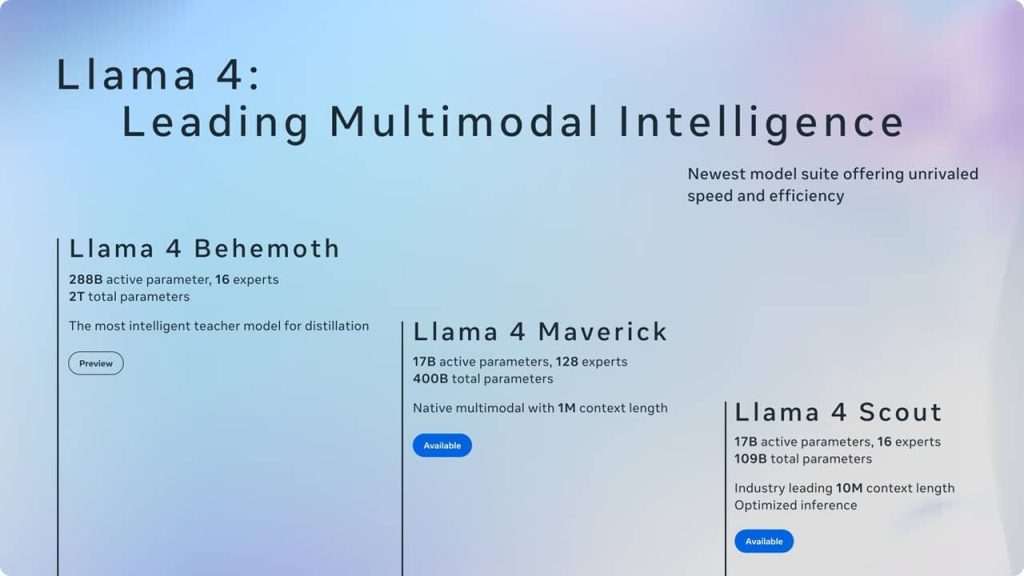

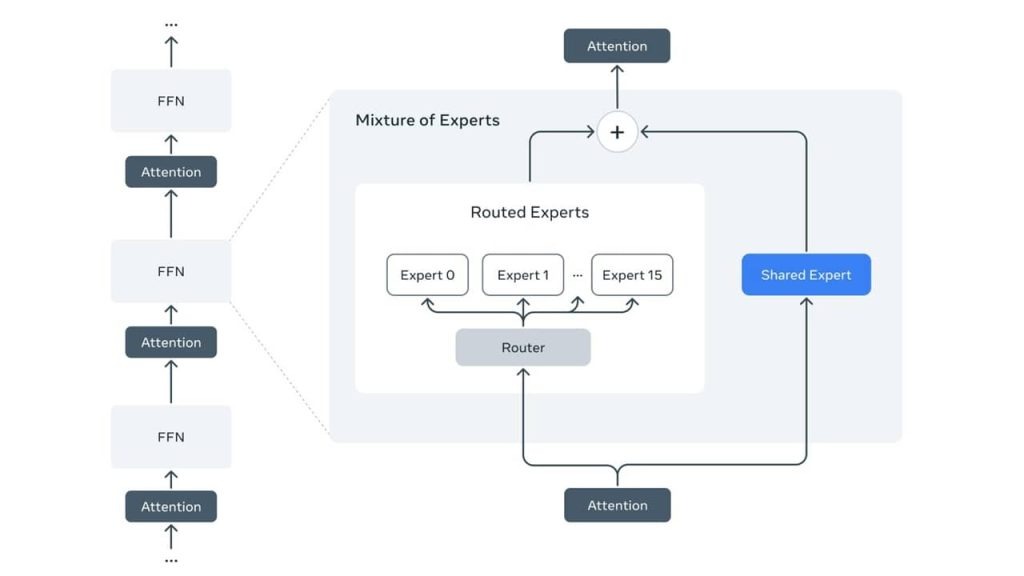

Llama 4 comprend trois modèles : Scout, Maverick (déjà disponibles), et Behemoth, encore en cours d’entraînement. Tous reposent sur une architecture Mixture-of-Experts (MoE). Cette dernière permettrait d’augmenter la puissance de traitement tout en limitant les coûts. Cette approche active certains sous-modèles selon la tâche, ce qui optimise les performances.

Scout se distingue par un contexte de 10 millions de tokens. Idéal pour résumer des documents massifs ou analyser des bases de code. Il peut fonctionner sur un simple GPU Nvidia H100, ce qui en fait une solution très accessible. Maverick, avec ses 400 milliards de paramètres totaux et 17 milliards actifs, cible des usages généralistes. Nous pouvons mentionner l’assistant conversationnel, le raisonnement logique ou encore l’écriture créative.

Behemoth, bien que non encore disponible, promet des performances supérieures à GPT-4.5 ou Claude Sonnet 3.7. Cela se ressentira dans le futur sur des tâches mathématiques et logiques complexes. Cependant, il reste en deçà de DeepSeek R1 ou OpenAI o1 sur certains benchmarks exigeants.

Selon Meta, Llama 4 Maverick surpasse GPT-4o et Gemini 2.0 Flash sur plusieurs benchmarks multimodaux, tout en restant plus abordable. Son coût d’inférence se situe entre 0,19 dollar et 0,49 dollar par million de tokens. Et cela, contre environ 4,38 dollars pour GPT-4o.

En parallèle, Meta introduit une nouvelle approche de méta-apprentissage baptisée MetaP. Elle permet de définir des hyperparamètres sur un petit modèle, puis de les appliquer à des modèles plus grands sans perte de cohérence. Ce procédé améliore nettement l’efficacité du développement.

VOIR AUSSI : Qu’est-ce que DeepSeek et pourquoi fait-il trembler les géants de l’IA ?

Une alternative open source sous conditions

L’un des points forts de Llama 4 est certainement son accessibilité. Les modèles sont disponibles gratuitement sur llama.com, via Hugging Face, et intégrés dans les applications Meta AI (WhatsApp, Messenger, Instagram). Toutefois, leur licence impose plusieurs restrictions. En effet, les entités basées dans l’Union européenne ne peuvent ni utiliser ni redistribuer les modèles. En outre, les entreprises avec plus de 700 millions d’utilisateurs doivent obtenir une licence spéciale.

Enfin, Meta insiste sur l’équilibre politique de Llama 4, qui refuse moins souvent les questions sensibles et offre des réponses jugées plus neutres. Des outils de sécurité comme Llama Guard et Prompt Guard ont également été intégrés.

Pour les développeurs en quête de performances multimodales avec un bon rapport coût-efficacité, Llama 4 constitue une alternative crédible. Et cela par rapport aux modèles Gemini 2.0 de Google, GPT-4 d’OpenAI ou Claude d’Anthropic. Si vous voulez tester les modèles déjà disponibles, vous pouvez les télécharger ici.

Cependant, malgré leurs capacités, aucun des modèles Llama 4 n’est encore un vrai modèle de « reasoning » au sens du ChatGPT-4o d’OpenAI. Ceux-ci sont déjà capables de vérifier et d’affiner leurs réponses de manière fiable. Behemoth pourra peut-être inverser cette tendance.

IdealoGeek est un média indépendant. Soutiens-nous en nous ajoutant à tes favoris sur Google Actualités :