Dans un effort pour protéger les utilisateurs contre les abus liés à l’intelligence artificielle (IA), Google a récemment mis à jour ses directives. Ces nouvelles politiques visent à limiter la diffusion de contenus inappropriés. On parle notamment des deepfakes explicites non consensuels. Cette décision intervient dans un contexte de préoccupations croissantes concernant l’utilisation de la technologie IA. Celle-ci est souvent utilisée pour créer des images nuisibles et non sollicitées, incluant les mineurs. Et cela, souvent à l’insu des individus concernés.

Sommaire :

Nouvelles exigences pour les développeurs

Les nouvelles directives de Google exigent que les développeurs s’assurent que leurs applications ne génèrent pas de contenus restreints. Prenons par exemple les images sexuellement explicites ou violentes.

Les développeurs doivent également fournir des mécanismes permettant aux utilisateurs de signaler tout contenu inapproprié généré par l’IA. Cette mesure vise à responsabiliser les créateurs d’applications et à protéger les utilisateurs contre les abus.

Les développeurs sont désormais tenus de « tester minutieusement » leurs outils et modèles d’IA pour s’assurer qu’ils respectent la sécurité et la confidentialité des utilisateurs. Si ces directives ne sont pas respectées, les applications concernées peuvent être retirées du Google Play Store.

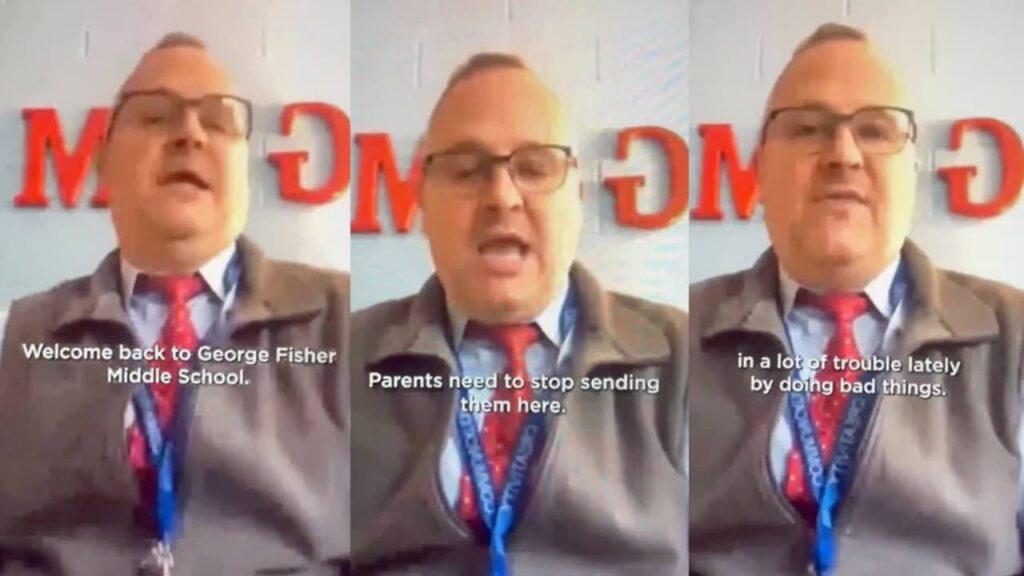

L’utilisation abusive de la technologie deepfakes alimentée par l’IA dépasse le cadre des médias sociaux. Des rapports indiquent que des élèves utilisent ces applications pour créer et diffuser des images explicites de leurs camarades de classe. Cela s’est passé dans des écoles aux États-Unis. Un incident marquant impliquait un deepfake raciste visant un directeur d’école. Ce qui a conduit à une arrestation à Baltimore, mettant en évidence la gravité de la situation.

VOIR AUSSI : Deepfakes de GirlsDoP*rn : une véritable menace pour les femmes !

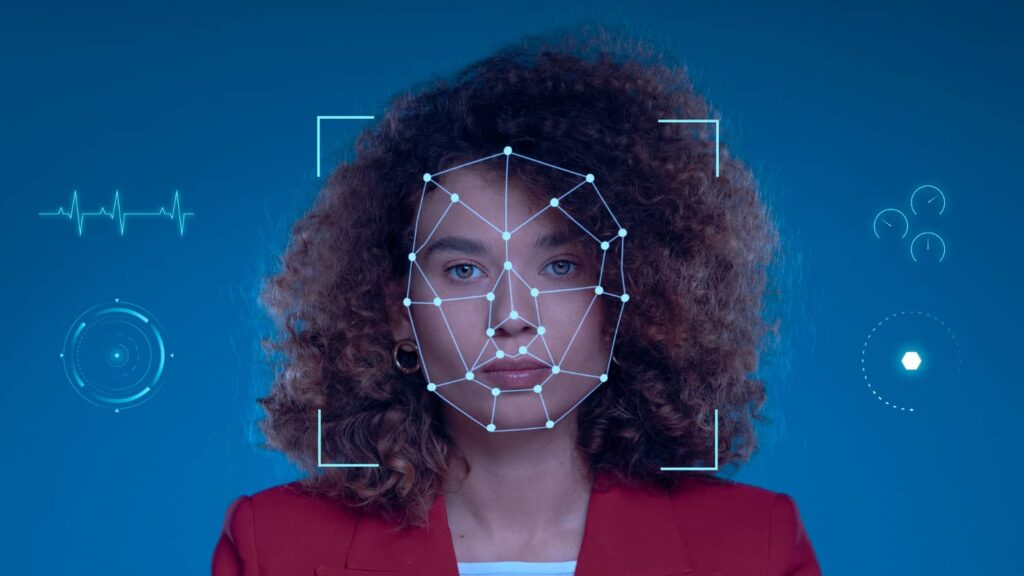

Un nouvel outil pour contrer les deepfake

Une mise à jour de l’algorithme de recherche de Google devrait rendre le processus de signalement plus simple et rapide. Désormais, lorsque vous demandez la suppression d’un faux contenu explicite, Google identifiera également des contenus similaires dans des recherches connexes. Il ne se limitera pas seulement à supprimer le contenu spécifique signalé. Google s’occupera de repérer tous les doublons de l’image explicite que vous souhaitez faire retirer.

Le géant du web améliore également son système de classement des résultats pour ces contenus. Dorénavant, lorsque vous effectuerez une recherche concernant un faux contenu explicite associé au nom d’une personne, les premiers résultats mettront en avant du contenu non explicite. De plus, si Google constate qu’un site web enfreint régulièrement les règles de recherche, il pénalisera le classement de ce site.

L’année passée, Google a introduit la fonctionnalité « À propos de cette image », permettant aux utilisateurs de consulter l’historique d’une image. Cet outil permet de savoir où l’image a été utilisée sur internet. Il informe de plus ce qu’en disent les sites de vérification des faits. Il aide ainsi à vérifier les affirmations faites concernant une image.

VOIR AUSSI : Comprendre l’identité numérique : ses avantages et ses risques

Une lutte continue contre les Deepfakes

Les actions de Google s’inscrivent dans un effort plus large. Ils visent en effet à lutter contre les abus facilités par les technologies avancées. En 2023, la société a bloqué plus de 300 000 comptes responsables de l’ajout de logiciels malveillants ou d’applications frauduleuses sur la plateforme. Cependant, les experts soulignent que des efforts supplémentaires sont nécessaires.

La collaboration entre les entreprises technologiques, les décideurs politiques et les organisations de la société civile est cruciale pour élaborer des réglementations robustes. Google et d’autres géants de la technologie, comme Apple, doivent continuer à adapter leurs politiques.

Leave a Reply